🎯 EssentIAI – Édition #02

📊 Microsoft généralise les agents, Moderna réinvente l’organigramme, Les IA révèlent leurs biais, l’IA évalue nos leaders, La confiance stagne, Les CEO doutent - Outil: La voix devient stratégique

🧭 L’Essentiel

Bienvenue dans ce second numéro d’EssentIAI: la veille stratégique qui trie décrypte l’IA.

Vous êtes plus de 100 nouveaux abonnés en une semaine 🤩. Ça compte beaucoup pour moi. Merci d’être là dès le début.

📬 Si ce format vous plait, faites-le vivre: partagez un article, transférez cette édition, citez une idée en réunion. Le signal ne devient utile que s’il circule.

🙏 Un immense merci à celles et ceux qui parlent d’EssentIAI autour d’eux! C’est grâce à vous que notre communauté va grandir. Un remerciement particulier à Ioulia Mickaïloff, Loïc Lengrand, Leila Hertzog, Virginie Arnal, Sylvio Desjardins, Olivier Rozec, Thierry De Couvreur & Jérémy Abramowski pour votre soutien et rayonnement ☀️🚀

Dans cette édition : des IA qui trouvent leur place dans les équipes, des CEO encore en équilibre instable entre ambition et exécution, et la fusion progressive des départements IT et RH pour piloter les agents IA.

Mais aussi : des algorithmes qui trahissent leurs biais. À ce sujet, je publie ce matin sur LinkedIn au sujet de du scandale qui frappe Workday et de ce qu’il révèle sur les limites actuelles des outils RH/TA dopés à l’IA.

Au menu de cette édition on parlera aussi de stratégie, gouvernance, d’arbitrages organisationnels… et de cette ligne de plus en plus floue entre simple assistance et automatisation complète.

On y va ?

🔎 La Veille Filtrée

🤖 Stratégie - Travailler avec des agents IA: la nouvelle norme ? (EN)

Microsoft envisage un avenir où chaque employé deviendra un "agent boss", supervisant plusieurs d'agents IA pour augmenter l'efficacité sans augmenter les effectifs. Une étude auprès de 800 employés de P&G révèle que les individus assistés par l'IA égalent les performances des équipes humaines seules, et que les équipes hybrides surpassent toutes les autres en matière d'innovation. Microsoft propose une transformation en trois phases : assistant IA individuel, collègues numériques, puis agents autonomes supervisés par l'humain.

🧠 Organisation - Fusion RH et IT pour piloter 3000 Agents (FR)

Moderna a fusionné ses départements RH et IT pour créer une collaboration homme-machine à grande échelle. Ce nouveau modèle, dirigé par un Chief People & Digital Officer, supervise 5 800 employés et 3 000 agents IA, reflétant une transformation organisationnelle profonde. L'objectif est de fluidifier les flux de travail, en remplaçant les rôles statiques par des interactions dynamiques entre humains et IA. Cette approche cherche à aligner les talents et la technologie pour mieux se préparer à l'IA.

🧭 Biais - TrackingAI révèle le QI et les biais politiques des IA grand public (EN)

TrackingAI est une plateforme qui analyse quotidiennement l’évolution du QI & des biais politiques des différents modèles d'IA. Les résultats montrent que la plupart des IA grand public penchent vers la gauche économique et sont socialement libertaires. Cette initiative souligne l'importance de la transparence et de la diversité dans les données d'entraînement des IA.

🧠 Leadership - Où l'IA doit-elle intervenir ? (EN)

L'article analyse l'intégration de l'IA dans l'évaluation et la sélection des leaders. L'IA excelle dans l'automatisation des tâches administratives, la synthèse de données et la proposition de plans de développement personnalisés. Cependant, elle ne doit pas remplacer l'expertise humaine, notamment pour l'interprétation contextuelle et la motivation des candidats. Les auteurs insistent sur la nécessité de valider scientifiquement les outils d'IA et de garantir leur conformité légale, en particulier face aux algorithmes opaques. Ils recommandent une approche combinant outils internes et externes, validés pour prédire efficacement la performance.

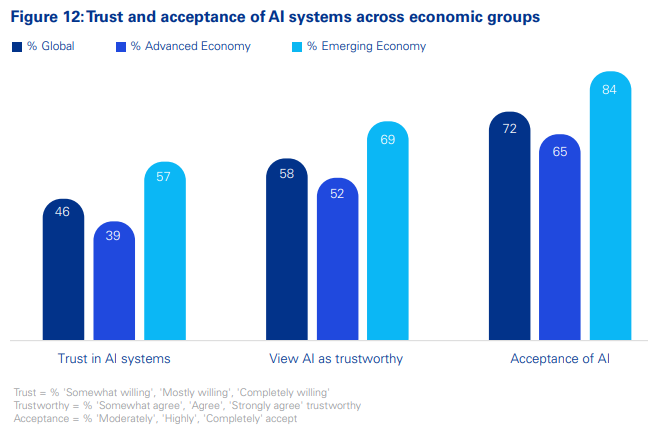

🌍 Paradoxe Mondial - L’IA progresse, la confiance reste fragile (EN)

Cette étude mondiale de KPMG, menée auprès de 48 000 personnes dans 47 pays, révèle une adoption massive de l'IA (66% l'utilisent régulièrement), mais une confiance limitée: seulement 46% des répondants sont prêts à lui faire confiance. Les économies émergentes (Inde, Nigeria, Chine) affichent des niveaux de confiance et d'usage plus élevés que les pays développés, où les préoccupations éthiques freinent l'adoption. Au travail, 57% des employés dissimulent leur utilisation de l'IA, souvent sans formation ni cadre clair, exposant les entreprises à des risques de conformité et de qualité. L'étude souligne l'urgence d'investir dans la formation, la gouvernance et la transparence pour aligner usage et confiance.

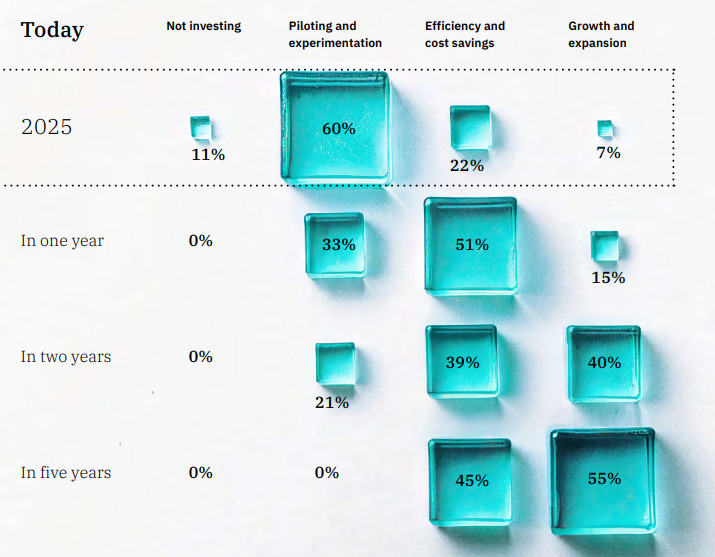

📊 Gouvernance - Ce que pensent (vraiment) les CEO (EN)

IBM a interrogé 2 000 CEO dans 33 pays: l’IA est une évidence stratégique, mais la mise à l’échelle reste laborieuse. Si 61% des dirigeants disent adopter activement les agents IA, 60 % admettent rester bloqués en phase pilote ! La priorité glisse du fantasme technologique vers le retour concret: 65% priorisent selon le ROI. Autre signal fort : 68% estiment que l’IA redéfinit le cœur même de leur business model. Pour en tirer parti, 72% misent sur leurs données propriétaires, et 31 % de leurs équipes devront être reformée sous trois ans.

📢 Ce que tu lis te plais ?

Fais suivre à des personnes autour de toi.

Parles-en sur LinkedIn. Mentionne-le dans une discussion.

C’est comme ça que le signal circule.

🧰 Dans la boîte à outils

🗣️ Sesame: vers des voix numériques véritablement humaines (EN)

Sesame dévoile CSM (Conversational Speech Model): une nouvelle génération de voix IA conçue pour dialoguer de manière fluide, humaine et émotionnellement pertinente. Le modèle combine intelligence émotionnelle, dynamique de conversation et conscience contextuelle pour créer des interactions vocales qui ne sonnent plus artificielles. Objectif: instaurer une véritable présence vocale.

🔭 La perspective

Et si la voix devenait le prochain levier de confiance en IA?

Longtemps, les voix générées par IA ont buté sur un plafond de verre: celui de la vallée de l’étrange. Ce moment où la ressemblance devient troublante, presque dérangeante.

Avec son modèle CSM, Sesame amorce une rupture: passer de la voix fonctionnelle à la voix relationnelle. Ce modèle ne se contente plus d’imiter les mots. Il capte les émotions, adapte le rythme, comprend le contexte conversationnel. Bref, il crée une illusion de présence.

Pourquoi c’est stratégique? Parce que dans bien des cas d’usage (assistant virtuel, hotline, formation, accompagnement santé), ce n’est pas l’info qui compte, c’est la relation. Et la voix est un puissant vecteur d’adhésion, d’empathie et de confiance.

👉 Laurent Brouat le souligne dans sa dernière newsletter: l’impact sur le recrutement est déjà là: des IA, accessibles à toute heure, sans stress ni jugement. Je ne peux que confirmer. Lors de mon Live - Sourceurs? Non, peut-être en Janvier, un dev nous racontait son entretien avec une IA: bluffant et ce n’est pas du niveau de Sesame.

À l’heure où la confiance dans l’IA avance plus lentement que son adoption, cette évolution est un vrai signal : la voix devient un levier clé de réassurance, d’appropriation… voire de préférence.

La voix n’est pas un gadget UX : c’est un canal stratégique pour humaniser l’IA, restaurer la confiance et créer de la valeur d’usage.

💬 Essaie Sesame et dis-moi ce que tu en penses en commentaire.

📢 Si ça t’a plu, parles-en autour de toi.

Le signal se propage de personne à personne.

Pas d’algo. Juste toi.

📬 Pour ne rien rater des prochaines éditions